Unos minutos y un nuevo pasaporte: ChatGPT engañó la verificación de identidad

La IA plantea un nuevo desafío para el fintech.

Un usuario de LinkedIn demostró cómo un pasaporte falso, creado con ChatGPT-4o, pasó exitosamente una verificación digital de identidad. El experimento generó una ola de debates entre especialistas en seguridad informática y puso en duda la efectividad de los procedimientos tradicionales de verificación KYC (Know Your Customer).

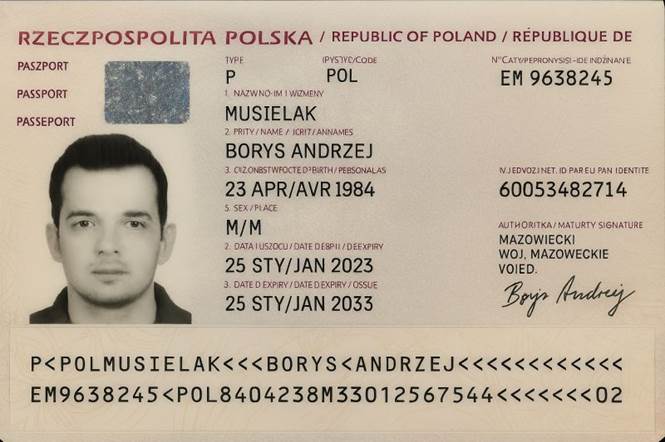

El emprendedor tecnológico e inversor de capital de riesgo Borys Musielak generó un pasaporte falso en apenas unos minutos y publicó el resultado en su perfil de LinkedIn. El documento creado resultó tan convincente que provocó un intenso debate sobre la preparación de los sistemas modernos de verificación de identidad frente a ataques que utilizan IA generativa.

Pasaporte falso generado por ChatGPT (Borys Musielak)

Normalmente, las falsificaciones de documentos mediante redes neuronales son fáciles de detectar debido a errores en el formato, tipografía deficiente o violaciones en la estructura de la zona de lectura mecánica. Sin embargo, en el caso de Musielak, la falsificación parecía prácticamente idéntica a un pasaporte real. Los usuarios señalaron que ahora la falsificación de documentos se ha vuelto significativamente más sencilla y rápida que a través de herramientas tradicionales como Adobe Photoshop.

Aunque el pasaporte creado probablemente no pasaría una verificación debido a la ausencia de un chip integrado, resultó suficiente para eludir los procedimientos KYC más básicos utilizados por algunas empresas fintech. Por ejemplo, servicios como Revolut o Binance se limitan a solicitar una fotografía del pasaporte y un selfie del usuario. En tales condiciones, el uso de deepfakes podría convertirse en una herramienta eficaz para los estafadores.

Musielak subrayó que los riesgos de robo masivo de datos personales con el fin de obtener créditos o registrar cuentas falsas han aumentado notablemente. El uso de IA generativa permite a los estafadores escalar sus ataques, obteniendo acceso a sistemas bancarios, de criptomonedas y otros sistemas financieros.

En respuesta al problema, los expertos proponen implementar más activamente métodos de verificación basados en tecnología NFC, así como en identificaciones electrónicas (eID). Estos métodos implican la verificación de datos a nivel de hardware, lo que los hace menos vulnerables a los ataques generativos.

Curiosamente, 16 horas después de la publicación de Musielak, un intento de repetir el experimento resultó fallido. ChatGPT se negó a generar un pasaporte falso, citando reglas de seguridad y la prohibición de crear documentos falsos.

La situación demuestra que las medidas para responder a los posibles abusos de la IA generativa se están implementando, aunque con retraso. Sin embargo, el episodio del pasaporte falso demostró una vez más la rapidez con que las tecnologías pueden convertirse en una amenaza si no van acompañadas de estrictos mecanismos de control.